Me siento asustado. Muy asustado.

La vigilancia y la censura en Internet, habilitadas por el inimaginablemente vasto poder computacional de la inteligencia artificial (IA), ya están aquí.

Esta no es una distopía futurista. Está sucediendo ahora.

Las agencias gubernamentales están trabajando con universidades y organizaciones sin fines de lucro para utilizar herramientas de inteligencia artificial para vigilar y censurar contenido en Internet.

Esto no es político ni partidista. No se trata de ninguna opinión o idea en particular.

Lo que está sucediendo es que una herramienta lo suficientemente poderosa como para vigilar todo lo que se dice y se hace en Internet (o gran parte de ello) está a disposición del gobierno para monitorearnos a todos, todo el tiempo. Y, basándose en ese seguimiento, el gobierno –y cualquier organización o empresa con la que se asocie– puede utilizar la misma herramienta para suprimir, silenciar y clausurar cualquier discurso que no le guste.

Pero eso no es todo. Utilizando la misma herramienta, el gobierno y sus socios público-privados “no gubernamentales” (pensemos, por ejemplo: la Organización Mundial de la Salud o Monsanto) también pueden cerrar cualquier actividad vinculada a Internet. Realizar operaciones bancarias, comprar, vender, enseñar, aprender, entretenerse, conectarse entre sí: si a la IA controlada por el gobierno no le gusta lo que usted (¡o sus hijos!) dice en un tweet o un correo electrónico, puede cerrar todo eso por tú.

Sí, hemos visto esto a una escala muy local y politizada con, por ejemplo, los camioneros canadienses .

Pero si pensábamos que este tipo de actividad no podría o no ocurriría a escala nacional (o incluso más aterradora: global), debemos despertar ahora mismo y darnos cuenta de que está sucediendo y que tal vez no sea posible detenerlo.

Nuevos documentos muestran que la IA financiada por el gobierno está destinada a la censura en línea

El Subcomité Selecto de la Cámara de Representantes de los EE. UU. sobre la Armamento del Gobierno Federal se formó en enero de 2023 “para investigar asuntos relacionados con la recopilación, el análisis, la difusión y el uso de información sobre ciudadanos estadounidenses por parte de las agencias del poder ejecutivo, incluso si dichos esfuerzos son ilegales, inconstitucionales , o de otra manera poco ético «.

Desafortunadamente, el trabajo del comité es visto, incluso por sus propios miembros, como en gran medida político: los legisladores conservadores están investigando lo que perciben como el silenciamiento de las voces conservadoras por parte de agencias gubernamentales de tendencia liberal.

Sin embargo, en sus investigaciones, este comité ha descubierto algunos documentos sorprendentes relacionados con los intentos del gobierno de censurar el discurso de los ciudadanos estadounidenses.

Estos documentos tienen implicaciones cruciales y aterradoras para toda la sociedad.

En el informe provisional del Subcomité, fechado el 5 de febrero de 2024 , los documentos muestran que grupos académicos y sin fines de lucro están proponiendo a una agencia gubernamental un plan para utilizar “servicios de desinformación” de IA para censurar contenido en plataformas de Internet.

Específicamente, la Universidad de Michigan está explicando a la Fundación Nacional de Ciencias (NSF) que las herramientas impulsadas por IA financiadas por la NSF se pueden utilizar para ayudar a las plataformas de redes sociales a realizar actividades de censura sin tener que tomar decisiones sobre qué se debe censurar.

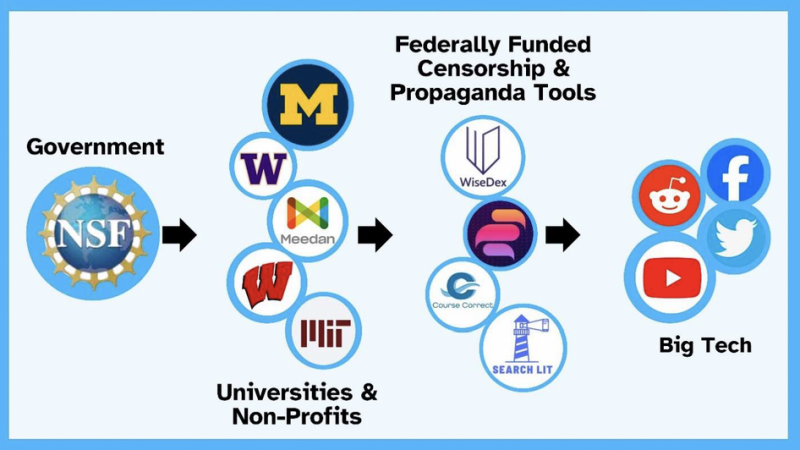

Así es como se visualiza la relación en el informe del Subcomité:

Aquí hay una cita específica presentada en el informe del Subcomité. Proviene de «Notas del orador del primer discurso de la Universidad de Michigan a la Fundación Nacional de Ciencias (NSF) sobre su herramienta WiseDex impulsada por IA y financiada por la NSF». Las notas están archivadas en el comité.

Nuestro servicio de desinformación ayuda a los responsables políticos de las plataformas que quieren… trasladar la responsabilidad de juicios difíciles a alguien fuera de la empresa… externalizando la difícil responsabilidad de la censura.

Esta es una declaración extraordinaria en muchos niveles:

- Equipara explícitamente el “servicio de desinformación” con la censura.

Esta es una ecuación crucial, porque los gobiernos de todo el mundo pretenden combatir la desinformación dañina cuando en realidad están aprobando proyectos de ley de censura masiva . El FEM declaró que la “desinformación y la desinformación” eran los “riesgos globales más graves” en los próximos dos años, lo que presumiblemente significa que sus mayores esfuerzos se destinarán a la censura.

Cuando un contratista gubernamental declara explícitamente que está vendiendo un “servicio de desinformación” que ayuda a las plataformas en línea a “externalizar la censura”, se reconoce que los dos términos son intercambiables.

- Se refiere a la censura como una “responsabilidad”.

En otras palabras, asume que parte de lo que deberían estar haciendo las plataformas es censura. No proteger a los niños de los depredadores sexuales ni a los ciudadanos inocentes de la desinformación: simplemente, una censura pura y simple.

- Afirma que el papel de la IA es “externalizar” la responsabilidad de la censura.

Las plataformas Tech no quieren tomar decisiones de censura. El gobierno quiere tomar esas decisiones pero no quiere que se le considere censurador. Las herramientas de inteligencia artificial permiten a las plataformas «externalizar» las decisiones de censura y al gobierno ocultar sus actividades de censura.

Todo esto debería acabar con la ilusión de que lo que los gobiernos de todo el mundo llaman “contrarrestar la desinformación y el discurso de odio” no es pura censura.

¿Qué sucede cuando se implementa plenamente la censura de la IA?

Sabiendo que el gobierno ya está pagando por herramientas de censura de IA, tenemos que entender lo que esto implica.

Sin límites de mano de obra: Como señala el informe del Subcomité, los límites a la censura gubernamental en línea han involucrado, hasta ahora, la gran cantidad de humanos necesarios para revisar archivos interminables y tomar decisiones de censura. Con la IA, casi no es necesario involucrar a ningún ser humano, y la cantidad de datos que se pueden vigilar puede ser tan vasta como todo lo que alguien dice en una plataforma en particular. Esa cantidad de datos es incomprensible para un cerebro humano individual.

Nadie es responsable: uno de los aspectos más aterradores de la censura de la IA es que cuando la IA lo hace, no hay ningún ser humano u organización (ya sea el gobierno, las plataformas o la universidad/organizaciones sin fines de lucro) que sea realmente responsable de la censura. . Inicialmente, los humanos dan instrucciones a la herramienta de inteligencia artificial sobre qué categorías o tipos de lenguaje censurar, pero luego la máquina sigue adelante y toma decisiones caso por caso por sí sola.

No hay recurso para quejas: una vez que la IA se desata con un conjunto de instrucciones de censura, barrerá millones de puntos de datos en línea y aplicará acciones de censura. Si quieres impugnar una acción de censura de IA, tendrás que hablar con la máquina. Quizás las plataformas empleen humanos para responder a las apelaciones. Pero, ¿por qué harían eso cuando tienen IA que puede automatizar esas respuestas?

No hay protección para los jóvenes: una de las afirmaciones de los censores gubernamentales es que debemos proteger a nuestros niños de información dañina en línea, como contenido que los vuelve anoréxicos, los alienta a suicidarse, los convierte en terroristas de ISIS, etc. También de la explotación sexual. Todas estas son cuestiones graves que merecen atención. Pero no son tan peligrosas para un gran número de jóvenes como lo es la censura de la IA.

El peligro que plantea la censura de la IA se aplica a todos los jóvenes que pasan mucho tiempo en línea, porque significa que sus actividades y su lenguaje en línea pueden ser monitoreados y utilizados en su contra, tal vez no ahora, pero siempre que el gobierno decida perseguir a un tipo particular. del lenguaje o del comportamiento. Este es un peligro mucho mayor para un número mucho mayor de niños que el peligro que representa cualquier contenido específico, porque abarca toda la actividad que realizan en línea y afecta a casi todos los aspectos de sus vidas.

Aquí hay un ejemplo para ilustrar este peligro: digamos que su adolescente juega muchos videojuegos interactivos en línea. Digamos que prefiere los juegos diseñados por empresas chinas. Tal vez también vea a otros jugar esos juegos y participe en chats y grupos de discusión sobre esos juegos, en los que también participan muchos ciudadanos chinos.

El gobierno puede decidir el mes que viene, o el año que viene, que cualquiera que esté muy involucrado en videojuegos diseñados en China es un peligro para la democracia. Esto podría resultar en cerrar las cuentas de redes sociales de su hijo o negarle el acceso a herramientas financieras, como préstamos universitarios. También podría implicar marcarlo en sitios web de empleo o de citas como peligroso o indeseable. Podría significar que se le niega el pasaporte o se le incluye en una lista de vigilancia.

La vida de su adolescente se volvió mucho más difícil. Mucho más difícil que si estuviera expuesto a un vídeo de reclutamiento de ISIS o a una publicación de TikTok que glorifica el suicidio. Y esto sucedería a una escala mucho mayor que la explotación sexual que los censores están utilizando como caballo de Troya para normalizar la idea de la censura gubernamental en línea.

Servicios de censura monetizables : En teoría, una herramienta de inteligencia artificial propiedad del gobierno puede ser utilizada por una entidad no gubernamental con el permiso del gobierno y con la bendición de las plataformas que quieran “externalizar” la “responsabilidad” de la censura. Entonces, si bien el gobierno podría estar usando IA para monitorear y reprimir, digamos como ejemplo, el sentimiento contra la guerra, una empresa podría usarla para monitorear y reprimir, digamos como ejemplo, el sentimiento contra la comida rápida. El gobierno podría ganar mucho dinero vendiendo los servicios de las herramientas de inteligencia artificial a terceros. Las plataformas también podrían pedir una reducción. Por lo tanto, las herramientas de censura de IA pueden beneficiar potencialmente al gobierno, las plataformas tecnológicas y las corporaciones privadas. Los incentivos son tan poderosos que es casi imposible imaginar que no serán explotados.

¿Podemos revertir el rumbo?

No sé cuántas agencias gubernamentales y cuántas plataformas utilizan herramientas de censura de IA. No sé qué tan rápido podrán escalar.

No sé qué herramientas tenemos a nuestra disposición, aparte de crear conciencia e intentar presionar a los políticos y presentar demandas para evitar la censura gubernamental y regular el uso de herramientas de inteligencia artificial en Internet.

Si alguien tiene otras ideas, ahora sería el momento de implementarlas.

Government Funds AI Tools for Whole-of-Internet Surveillance and Censorship